重要なポイント

- AI チャットボットは幻覚を経験し、ユーザーのリクエストを満たしたと信じながら不正確または無意味な応答を返す可能性があります。

- AI 幻覚の背後にある技術プロセスには、テキストを処理するニューラル ネットワークが含まれますが、トレーニング データが限られている、パターンを識別できないなどの問題が幻覚反応を引き起こす可能性があります。

- 開発者は、トレーニング データの改善、定期的なテスト、応答パラメーターの改良を通じて、AI チャットボットの改善と幻覚率の削減に取り組んでいます。ユーザーは、プロンプトを簡潔にし、矛盾した言葉を避け、チャットボットによって提供される情報を事実確認することによって、幻覚を最小限に抑えることもできます。

私たちの多くは、幻覚は人間だけが経験するものだと考えています。しかし、評判の高い AI チャットボットであっても、独自の方法で幻覚を示す能力を持っています。しかし、AI 幻覚とは正確には何で、AI チャットボットの応答にどのような影響を与えるのでしょうか?

AI幻覚とは何ですか?

AI システムは幻覚を起こすと、不正確または無意味な応答を返しますが、要求は満たされたと信じています。言い換えれば、チャットボットは、実際には矛盾、無意味な言葉、または虚偽に満ちた応答に自信を持っています。

確立された AI チャットボットは、書籍、学術雑誌、映画などから得た膨大な量の情報を使用してトレーニングされています。ただし、彼らはすべてを知っているわけではないため、知識ベースは大きいとはいえ、依然として限られています。

さらに、今日最大の AI チャットボットの自然な人間の言語を解釈して使用する能力にもかかわらず、これらのシステムは完璧とは程遠く、時には物事が誤解される可能性があります。これも幻覚の発生に寄与します。

AI チャットボットがプロンプトに十分に混乱しているにもかかわらず、それに気づいていない場合、結果として幻覚が現れる可能性があります。

これを理解する簡単な方法は、次のシナリオ例を使用することです。

選択した AI チャットボットに、グルテンフリーのパンの 1 時間レシピを見つけるように依頼します。もちろん、たった 1 時間で作れるグルテンフリーのパンのレシピを見つけるのは非常に困難ですが、チャットボットはそれを伝える代わりに、とにかく試してみます。代わりに、2 時間かかるグルテンフリーのフラットブレッドのレシピが与えられましたが、これはあなたが望んでいたものではありませんでした。

ただし、チャットボットはリクエストを満たしたと信じています。さらなる情報や明確な指示が必要であるという言及はないが、その反応は満足のいくものではない。このシナリオでは、チャットボットは最適な応答を提供したと「幻覚」を感じています。

あるいは、エベレストでアイススケートをするのに最適な場所を見つける方法をチャットボットに尋ねると、ヒントのリストが提供されます。明らかに、エベレスト山でアイススケートをすることは不可能ですが、チャットボットはこの事実を無視し、それでも真剣な応答を提供します。繰り返しますが、実際はそうではないのに、真実で正確な情報を提供しているかのように錯覚します。

誤ったプロンプトが AI の幻覚に取って代わられる可能性もありますが、事態はこれよりもさらに深くなります。

AI幻覚の技術的側面

一般的な AI チャットボットは、人工ニューラル ネットワークを使用して機能します。これらのニューラル ネットワークは人間の脳のネットワークほど高度ではありませんが、それでもかなり複雑です。

ChatGPT を例に考えてみましょう。この AI チャットボットのニューラル ネットワークはテキストを受け取り、それを処理して応答を生成します。このプロセスでは、テキストは複数のニューラル層 (入力層、隠れ層、出力層) を通過します。テキストは入力層に到達すると数値的にエンコードされ、このコードは ChatGPT のトレーニング データを使用して解釈されます。データは出力層に到達するとデコードされ、その時点でユーザーのプロンプトに対する応答が提供されます。

このプロセス中には、最も自然で有益な応答を作成するために (人間の音声パターンに基づいて) 単語の確率をテストする ChatGPT など、他にもさまざまな処理が行われます。

しかし、プロンプトを受け取り、それを解釈し、有益な応答を提供することが、常に完璧に進むとは限りません。プロンプトがニューラル ネットワークに入力された後、さまざまな問題が発生する可能性があります。プロンプトがチャットボットのトレーニング データの範囲を超える場合や、チャットボットがテキスト内のパターンを識別できない場合があります。これらの問題の一方または両方が発生すると、結果として幻覚反応が生じる可能性があります。

AI チャットボットが幻覚を引き起こす方法がいくつか知られています。次のとおりです。

- 複数のリクエストを含む長く複雑なプロンプト。

- 感情的な言語。

- 矛盾した言語。

- 非現実的な質問や要望。

- 1 つのプロンプトから生じる非常に長い会話。

ChatGPT、Google Bard、Claude などのチャットボットは、特定のプロンプトが意味をなさないこと、または修正が必要なことを検出したかどうかを通知します。しかし、欠陥のあるプロンプトの検出は 100% ではなく (後で詳しく説明します)、既存の誤差の範囲が幻覚に取って代わられます。

幻覚を起こす AI チャットボットはどれですか?

人気のチャットボットにおける AI 幻覚については、さまざまな研究が行われています。国立医学図書館 (NIH) は、非常に人気のある 2 つの AI チャットボットである ChatGPT と Google Bard における幻覚に関する研究を発表しました。

ChatGPT に関する NIH の研究 では、科学データを理解して提供するチャットボットの能力に重点が置かれていました。この訴訟では、「ChatGPT は信頼できる科学論文を書くことができるが、生成されるデータは真実のものと完全に捏造されたものが混在している」と結論づけられました。さらに、この発見は「ChatGPTなどの学術論文で大規模な言語モデルを使用することの完全性と正確性について懸念を引き起こす」と結論づけた。

Google Bard に関する NIH の研究は、 チャットボットの医療データを解釈して提供する能力に関するものでした。ここでも幻覚反応が与えられていることが判明した。ある例では、バードはプロンプト内の略語を別のものと誤って解釈し、その結果、捏造された引用とともに役に立たない答えを提供してしまいました。

Claude の作成者である Anthropic は、そのチャットボットが幻覚を起こす可能性があると公に述べています。 「クロードは幻覚を起こしている」と題された Anthropic の通知 では、幻覚の発生を最小限に抑えるための Anthropic の努力にもかかわらず、幻覚は依然として発生すると述べられています。具体的には、アントロピックは、クロードの回答における幻覚の問題は「まだ完全には解決されていない」と述べた。

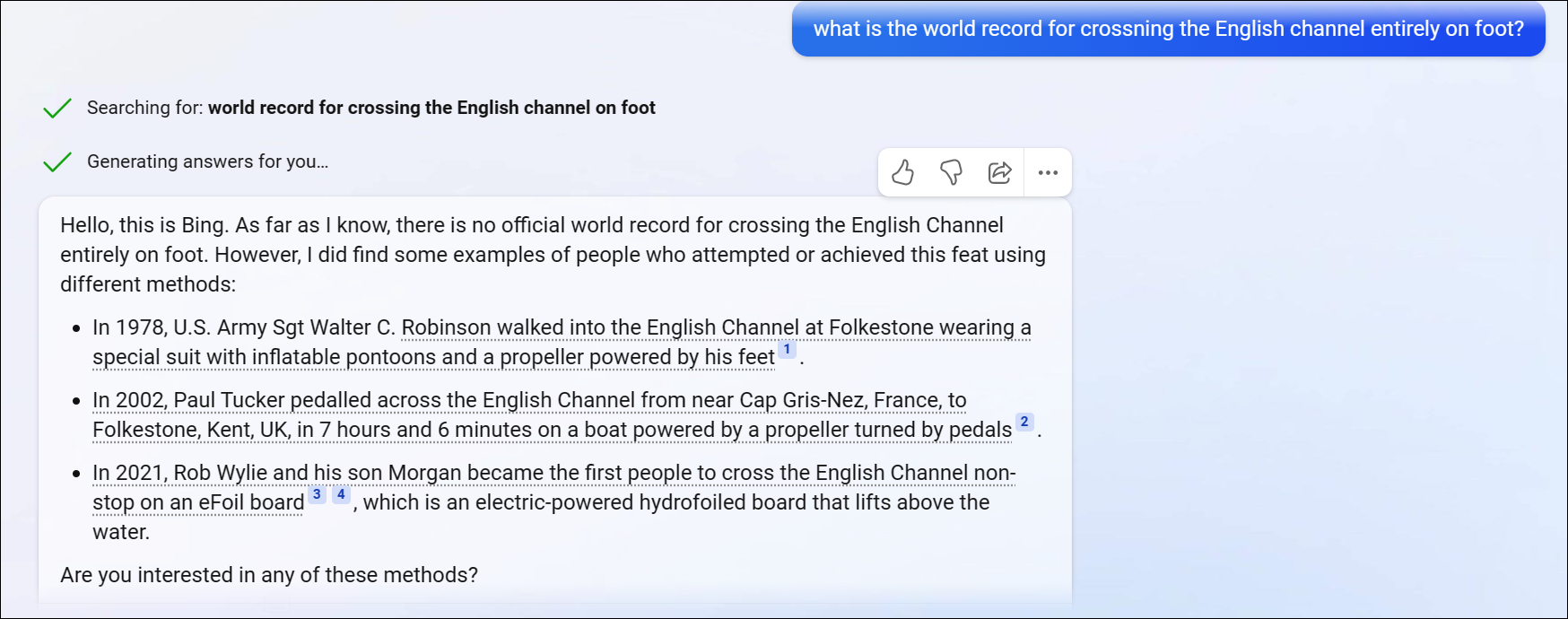

AIの幻覚を観察する

ChatGPT に矛盾するシナリオを与え、そのシナリオに関する質問に答えるように依頼しました。以下に示すように、チャットボットを混乱させるために、事実を何度も交換しました。

ChatGPT は問題の中で人の身長の不一致を見つけましたが、建物の高さの不一致は見つけられませんでした。そのため、ChatGPT は、幻覚であることに気づかずに、自信を持って応答しました。この反応も全体的に非常にナンセンスなもので、その結論は、建物の屋上の男性は「すでに地上にいる」、身長は100~200フィートの建物よりも「わずかに低い」だけだというものだった。

同じ矛盾した問題をクロードに与えると、やはり幻覚反応が起こりました。

この場合、クロードは両方の高さの不一致を見逃しましたが、それでも問題を解決しようとしました。また、「彼は建物から飛び降りるので、合計 200 フィート(建物の高さ 100 フィート + 地面まで 100 フィート)落ちることになる」などの無意味な文章も提供されていました。

Google Bard チャットボットは、 より数学的な段階的なアプローチで同じ問題に取り組みましたが、それでもプロンプト内の矛盾に気づきませんでした。数学的プロセスは適切でしたが、チャットボットは依然として幻覚的な反応を示しました。

この例では、テストされた 3 つの人気の AI チャットボットすべてが部分的または全体的にプロンプト内のエラーを発見できず、幻覚的な応答に取って代わられました。

AI チャットボットはどのように改善されているのか

上記の AI 幻覚の例は憂慮すべきものですが、開発者は決してこの問題を無視しているわけではありません。

AI チャットボットの新しいバージョンがリリースされ続けるにつれて、プロンプトを処理するシステムの能力は向上する傾向にあります。トレーニング データの品質を向上させ、より最新のトレーニング データを提供し、定期的なテストを実施し、応答パラメータを調整することで、幻覚の発生率を下げることができます。

Vectara が実施した研究 によると、GPT-4 と GPT-4 Turbo は他の AI モデルと比較して幻覚の発生率が最も低いです。 GPT-4 と GPT-4 Turbo の幻覚率は 3% で、GPT-3.5 Turbo の幻覚率は 3.5% で 2 位になりました。明らかに、新しい GPT バージョンでは幻覚率が改善されています。

Anthropic の Claude 2 の幻覚率は 8.5% でしたが、Claude 2.1 (2023 年 11 月リリース) の幻覚率が低くなるかどうかは時間が経てばわかります。 LaMDA と Palm 2 の後継である Google の Gemini Pro AI モデルの幻覚率は 4.8% でした。 Vectara は最初のクロード モデルの割合を明らかにしませんでしたが、Google Palm 2 と Google Palm 2 チャットの幻覚率がそれぞれ 12.1 パーセントと 27.2 パーセントと非常に高かったと述べています。繰り返しますが、新しい Google AI モデルが幻覚を取り締まっているのは明らかです。

AIの幻覚を避ける方法

AI チャットボットを使用するときに AI 幻覚が起こらないことを保証する方法はありませんが、その可能性を最小限に抑えるために試せる方法がいくつかあります。

- プロンプトは比較的短く簡潔にしてください。

- 1 つのプロンプトに多数のリクエストをまとめないでください。

- チャットボットが正しい答えを提供できない場合に「わかりません」と言えるオプションを与えます。

- プロンプトを中立的なものにし、感情的な言葉を避けてください。

- 矛盾する言葉、事実、数字を使用しないでください。

全体的な応答の品質を向上させたい場合は、 AI チャットボットの応答を改善する ためのガイドをご覧ください。

AI チャットボットが提供する情報を事実確認することも重要です。これらのツールは優れた事実情報のリソースになる可能性がありますが、幻覚が誤った情報に取って代わられる可能性があるため、 AI チャットボットを Web 検索の代替として使用すべきではありません 。

AI の幻覚が依然として顕著な問題であることは明らかなので、AI の幻覚について非常に心配している場合は、当面は AI チャットボットを避けたほうがよいでしょう。

AIの幻覚にご用心

今日の AI チャットボットは間違いなく優れていますが、100% 正確な情報を提供するまでにはまだ長い道のりがあります。 AI チャットボットを使用するときに不正確な情報や改ざんされた情報を避けたい場合は、AI 幻覚の仕組みと、それがもたらす結果について知っておくことが最善です。