)

物議を醸している Apple の オンデバイス CSAM スキャナ については、多くの話題が飛び交っています。同社はさらなる改善ができるまで展開を延期することを決定しており、いくつかの問題を聞いているようだ。

Apple の CSAM スキャン テクノロジー

Apple は 先月初めて児童性的虐待のスキャン を発表したが、 多少の抵抗 に遭った。クラウドにアップロードする際に画像をスキャンすることは新しいことではないが、Appleは スキャン画像をユーザーのデバイス上でハッシュする ことを意図していると述べ、これはプライバシーの侵害であると感じる人もいた。

Apple.com の声明の中で、同社はさらなる改善ができるまでスキャン技術の開発を延期するという決定を明らかにしました。

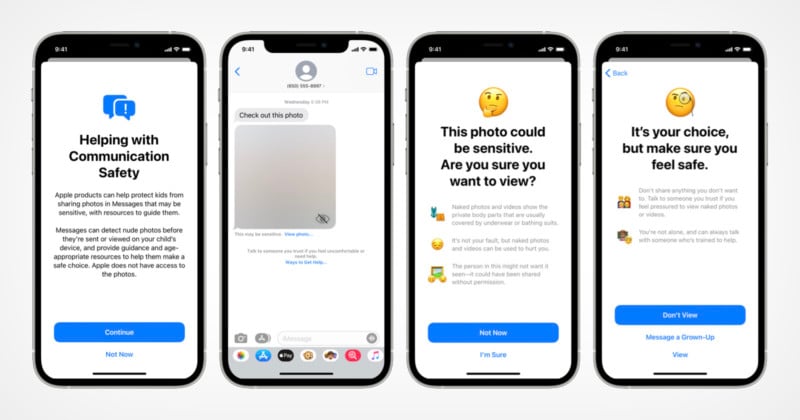

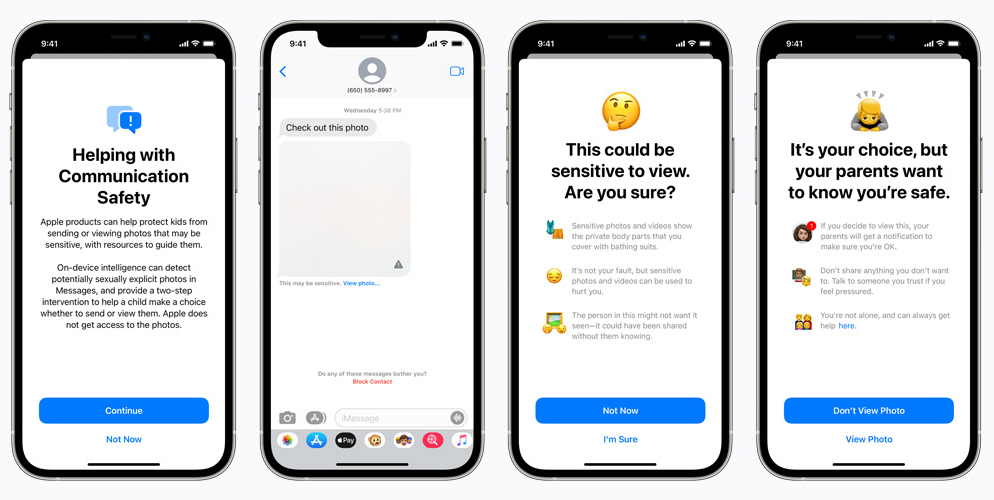

以前、私たちは、コミュニケーション ツールを使用して子供たちを勧誘し搾取する捕食者から子供たちを保護し、児童性的虐待マテリアルの拡散を制限するのに役立つ機能の計画を発表しました。お客様、擁護団体、研究者などからのフィードバックに基づいて、これらの非常に重要な子供の安全機能をリリースする前に、今後数か月間さらに時間をかけて意見を収集し、改善を図ることにしました。

Appleは、同社のCSAMスキャン技術は、クラウドにアップロードしてからスキャンするよりもユーザーにとって実際に優れていると述べている。同社はそのプロセスを次のように説明しています。

画像が iCloud 写真に保存される前に、その画像に対して既知の CSAM ハッシュと照合するデバイス上の照合プロセスが実行されます。この照合プロセスはプライベート セット交差と呼ばれる暗号化技術を利用しており、結果を明らかにせずに一致があるかどうかを判断します。デバイスは、画像に関する追加の暗号化データとともに一致結果をエンコードする暗号化安全バウチャーを作成します。このバウチャーは画像とともに iCloud 写真にアップロードされます。

計画では、スキャン機能を iOS 15 の一部として展開する予定でしたが、これは OS のもう 1 つの部分であり、まだリリースの準備が整っていません。同社はすでに、 iCloud Private Relay と SharePlay は iOS 15 のリリースには準備ができていないこと を発表しました。その CSAM スキャナーが、モバイル オペレーティング システムの遅延部分のリストに加わりました。