ChatGPT

、

Bing Chat

、

Google Bard

、または

その他のチャットボット

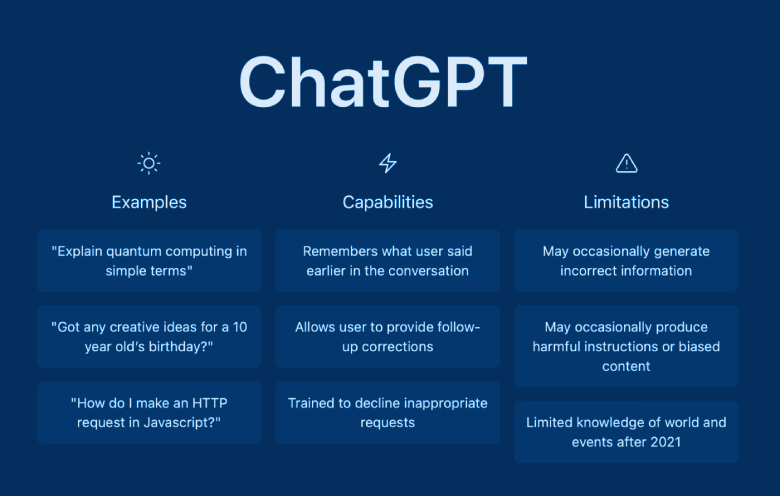

からのすべての内容を事実確認することが重要です。信じられないかもしれませんが、これは特に数学に当てはまります。 ChatGPT が数学を実行できると想定しないでください。現代の AI チャットボットは、数えたり計算したりするよりも、創造的な文章を書くほうが得意です。

チャットボットは電卓ではありません

いつものように、AI を扱うときは迅速なエンジニアリングが重要です。適切な応答を得るには、多くの情報を提供し、テキスト プロンプトを慎重に作成する必要があります。

しかし、たとえ応答として完璧なロジックを受け取ったとしても、その途中で目を細めて、ChatGPT が 1+1=3 の線に沿って間違いを犯したことに気づくかもしれません。ただし、ChatGPT は頻繁にロジックを間違えます。また、計算も得意ではありません。

大規模な言語モデルに電卓として機能するよう求めるのは、電卓に戯曲を書くよう求めるようなものです — 何を期待しましたか?それはそのためのものではありません。

ここでの主なメッセージは、AI の動作を二重チェックまたは三重チェックすることが重要であるということです。それは数学以外にも当てはまります。

以下に、ChatGPT がまったくうまくいかない例をいくつか示します。この記事では、gpt-3.5-turbo に基づく無料の

ChatGPT

と、GPT 4 に基づく

Bing Chat

を使用しました。そのため、ChatGPT Plus と GPT 4 は無料版の ChatGPT よりも優れたパフォーマンスを発揮しますが、これらの問題は、最先端の AI チャットボットであっても発生します。

ChatGPT がカウントできない

ChatGPT と Bing はアイテムのリストを数えるには信頼できないようです。これは基本的なタスクのように思えますが、信頼できる答えが得られるかどうかに依存しないでください。

ChatGPT に数値の列を提供し、そのうちの 1 つの数値の出現をカウントするように依頼しました。 (自分で数える必要はありません。正解は、100 という数字が 14 回現れることです。)

ChatGPT を修正し、謝罪して新しい答えを提示したとしても、必ずしも正しい答えが得られるとは限りません。

ChatGPT は、間違いを必死に隠蔽し、あなたを苦しめるために答えを (どんな答えでも構いません) 与えようとする人のように振る舞うことがよくあります。それは実際に非常に生き生きとしています!

いつものように、大きな問題の 1 つは、ChatGPT がさまざまな答えをマシンガンで返してくる場合でも、そのすべての答えについてどれだけ完全に確信しているかということです。

Microsoft の Bing Chat 経由で GPT 4 を試してみましたが、同様の問題が発生しました。 Bing は、この難しい問題を解決するために Python コードを作成することにしましたが、これも正しい答えを得ることができませんでした。 (Bing は実際にはコードを実行しませんでした。)

ChatGPT は数学論理の問題に苦戦しています

ChatGPT に数学の「文章問題」を与えると、正しい答えが得られない奇妙な論理のねじれが発生することがよくあります。

私たちは、ChatGPT にフルーツベースの数学問題を提供しました。これは、異なるファンド間で拠出金を配分することで投資ポートフォリオのバランスを調整しようとしている場合、または単にフルーツをたくさん買ってフルーツベースの投資に固執する場合に尋ねられそうな質問を反映しています。

飢えた投資家のための

ポートフォリオ。

ChatGPT は最初は問題ありませんが、すぐに軌道を外れ、意味をなさないロジックになり、正しい答えが得られません。

最終的な答えが間違っていることに気づくために、すべての紆余曲折をたどる必要はありません。

ChatGPT は、その応答についても掘り下げて議論することがよくあります。 (繰り返しますが、それは非常に人間らしい行動です。)

この場合、ChatGPT は、正しい答えは得られませんでしたが、以前よりも希望の比率に近づくことができたと主張しました。それはかなり面白いですね。

記録のために言っておきますが、GPT 4 ベースの Microsoft の Bing Chat もこの問題に苦戦しており、明らかに間違った答えが得られました。 GPT 4 のロジックはここでもすぐに狂ってしまいます。

論理のあらゆる展開に従おうとしないことをお勧めします。答えが間違っているのは明らかです。

私たちが Bing の答えが間違っていると指摘すると、Bing は次々と間違った答えを提示して、堂々巡りで私たちと議論を続けました。

ChatGPT も算術演算を確実に実行できない

ChatGPT は時々調子に乗って基本的な算術を間違って記述することもあることは注目に値します。論理的な答えの真ん中にある 1+1=3 のような、算術が間違っている問題に対する論理的な答えを見てきました。

ChatGPT や他の AI チャットボットから取得したものはすべて、必ずチェック、二重チェック、三重チェックしてください。