本日、NVIDIA は新しい Ampere アーキテクチャと、それが動作する新しい A100 を発表しました。これは、ハイエンドのデータセンターと消費者向けグラフィックス空間での ML を活用したレイトレーシングを強化する AI に重点を置いたアーキテクチャである Turing に比べて大幅な改善です。

非常に技術的な詳細をすべてまとめて知りたい場合は、NVIDIA の 詳細なアーキテクチャの概要 を読むことができます。最も重要なものを分解していきます。

新しい金型は非常に巨大です

彼らは最初からこの新しいチップに全力で取り組んでいます。前世代の Tesla V100 ダイは、TSMC のすでに成熟した 14nm プロセス ノード上で 815mm で、211 億個のトランジスタを備えていました。すでにかなり大きいですが、A100 は TSMC の 7nm で 826mm、より高密度のプロセス、そしてなんと 542 億個のトランジスタを搭載しており、顔負けです。この新しいノードは印象的です。

この新しい GPU は、19.5 テラフロップスの FP32 パフォーマンス、6,912 CUDA コア、40 GB のメモリ、および 1.6 TB/秒のメモリ帯域幅を備えています。かなり特殊なワークロード (まばらな INT8) では、A100 は実際に 1 ペタ FLOPS の生の計算能力を発揮します。もちろんINT8ですが、それでもこのカードは非常に強力です。

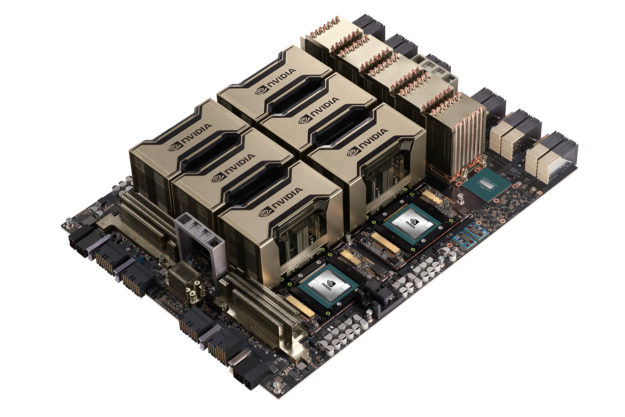

そして、V100 と同じように、これらの GPU を 8 つ使用してミニ スーパーコンピューターを作成し、20 万ドルで販売しています。おそらく、近いうちに AWS や Google Cloud Platform などのクラウド プロバイダーにも導入されることになるでしょう。

ただし、V100 とは異なり、これは 1 つの巨大な GPU ではありません。実際には 8 つの個別の GPU が仮想化され、さまざまなタスク用に独自にレンタルされ、起動時のメモリ スループットが 7 倍高くなります。

これらすべてのトランジスタを使用すると、新しいチップは V100 よりもはるかに高速に動作します。 AI トレーニングと推論に関して、A100 は、FP32 で 6 倍、FP16 で 3 倍、これらの GPU をすべて一緒に使用すると推論で 7 倍の高速化を実現します。

2 番目のグラフでマークされている V100 は、単一の V100 ではなく、8 GPU V100 サーバーであることに注意してください。

NVIDIA は、多くの HPC ワークロードで最大 2 倍の高速化も約束しています。

生の TFLOP 数値に関しては、A100 FP64 の倍精度パフォーマンスは 20 TFLOP ですが、V100 FP64 では 8 TFLOP です。全体的に見て、これらの高速化はチューリングに比べて世代を超えた真の進歩であり、AI および機械学習の分野にとって素晴らしいニュースです。

TensorFloat-32: Tensor コア用に最適化された新しい数値形式

Ampere では、NVIDIA は一部のワークロードで FP32 を置き換えるように設計された新しい数値形式を使用しています。基本的に、FP32 は数値の範囲 (数値の大小) に 8 ビット、精度に 23 ビットを使用します。

NVIDIA の主張は、これらの 23 精度ビットは多くの AI ワークロードに完全に必要なわけではなく、そのうちの 10 ビットだけでも同様の結果とはるかに優れたパフォーマンスを得ることができる、というものです。この新しい形式は Tensor Float 32 と呼ばれ、A100 の Tensor コアはこれを処理できるように最適化されています。これは、ダイの縮小とコア数の増加に加えて、AI トレーニングで 6 倍という大幅な高速化を実現している方法です。

彼らは、「TF32 は A100 GPU 内でのみ実行されるため、ユーザーはコードを変更する必要はありません。TF32 は FP32 入力で動作し、FP32 で結果を生成します。非テンソル演算は引き続き FP32 を使用します。」と主張しています。これは、追加の精度を必要としないワークロードの代替として使用する必要があることを意味します。

V100 の FP パフォーマンスと A100 の TF パフォーマンスを比較すると、この大幅な高速化がどこから来ているかがわかります。 TF32 は最大 10 倍高速です。もちろん、これの多くは、Ampere の他の改善点が全体的に 2 倍高速になったことによるものであり、直接比較するものではありません。

また、ディープ ニューラル ネットワークの計算パフォーマンスに貢献する、 細粒構造化スパース性 と呼ばれる新しい概念も導入しました。基本的に、特定の重みは他の重みよりも重要ではないため、行列の計算を圧縮してスループットを向上させることができます。データを破棄するのは良いアイデアとは思えませんが、訓練されたネットワークの推論の精度には影響せず、単に速度が向上するだけだと彼らは主張しています。

Sparse INT8 計算の場合、単一の A100 のピーク パフォーマンスは 1250 TFLOPS であり、驚くほど高い数値です。もちろん、INT8 のみをクランキングする実際のワークロードを見つけるのは難しいでしょうが、高速化は高速化です。